方法介绍

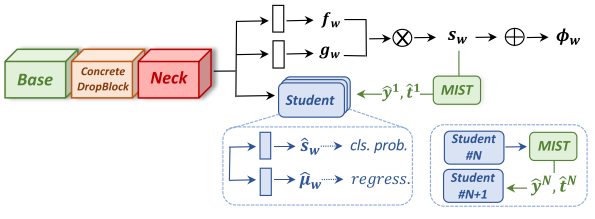

- W2F:

新的提取伪标签的策略:挑选前p%的伪标签,做nms - GAM:

用一个注意力网络(ResBlock+Hard Gumbel-Softmax)与整个网络对抗,drop掉判别性区域,称为Concrete DropBlock - Reg:

增加Regression分支

细节

Concrete DropBlock部分:Hard Gumbel-Softmax是一种把概率转换成0/1,并可以反传梯度的技巧。为了避免输出直接drop掉整个feature map,需要将每个点的概率和一个阈值[latex]\tau[/latex]取min。

一种节省显存的训练方法:从ROIPooling分开,前半部分先跑,后半部分将proposal分batch跑、反传梯度,然后前半部分再反传。

思考

DropBlock部分无疑是有些奇怪的,即使取了min,这个对抗无疑还是会学着去把整个feature map给drop掉。论文中并没有展示DropBlock的输出,值得怀疑会不会退化成random dropout。

可以思考的很深入,期待你的paper